- OS2 人・顔・動作

OS2-K

| 映像監視ソリューションの実現にむけた人物動作解析技術 |

|

○田靡雅基(パナソニック) |

|

|

1998年 : 早稲田大学大学院理工学研究科修士課程了 1998年 : 松下電器産業株式会社(現,パナソニック株式会社)入社 主に,人物行動センシングと行動分析技術に従事. ViEW2011小田原賞受賞. 概要: 我々は,公共空間や商業施設といった実環境下に設置された単眼カメラを用いて, 人物の行動認識をリアルタイムで実現するシステムを目指している. 実環境下での行動認識は,環境物・人物間の遮蔽といった環境変動や体型・服装・姿勢といった人物の多様性に対応しなければならない. 本講演では,環境変動や人物の多様性に対して頑健な人物検出・追跡・姿勢推定技術について述べる. |

OS1-O1

| 人物画像認識による来場者モニタリング |

|

○野口祥宏,嶋田敬士(旭化成),マノジペレラ(産総研),栗田多喜夫(広島大)

|

|

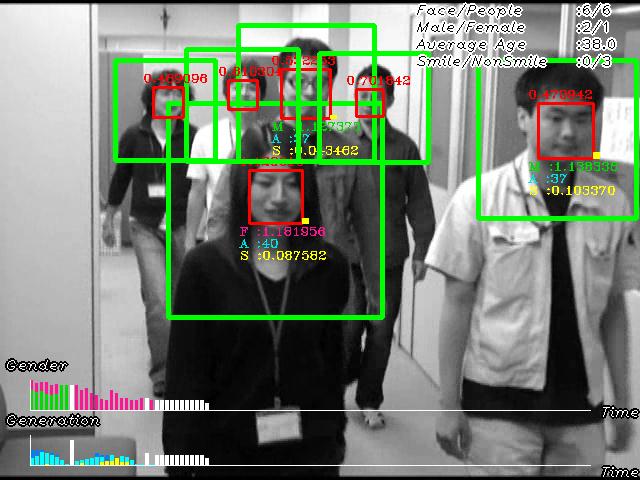

画像認識による上半身画像からの人物検出と顔画像からの人物属性推定の統合により,来場者調査を目的としたカメラ映像からの来場者モニタリング・システムを開発した.上半身での人物検出により人物の向きや重なりに対するロバスト性を高め,人物追跡結果から複数フレーム間での人物属性推定結果を総合的に判断することで信頼性を向上させた.また,人物追跡した複数フレームでの人物属性推定結果を総合判断することで安定した来場者モニタリングを実現した. <キーワード>上半身追跡,顔認識,人物属性 |

来場者モニタリング動作例 |

OS2-O2

| 表情変化に対する顔認証のための登録画像の自動生成 |

|

〇里中孝美(熊本県立技術短期大学校),小田亮介,内村圭一,上瀧剛,牧岡毅(熊本大)

|

|

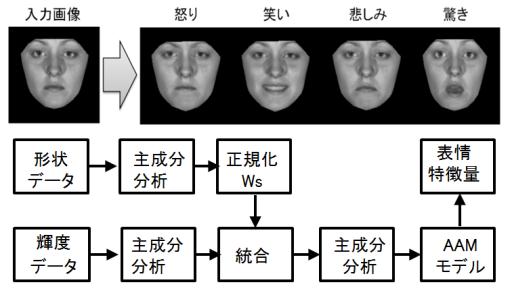

無表情の顔画像から表情変化を与えた新たな顔画像を生成するためには,熟練したアニメータによる作業が必要である.本研究では,複数表情を含む顔データベースを用いて,それと同様の表情変化を得るため,Active Appearance Model(AAM)を利用して表情変化のパラメータを推定した.AAMモデルでは,データベースの顔の形状と輝度データを主成分分析して表情変化を記述し,未知の顔画像に対してデータベースに含まれる表情変形の模倣が容易に可能となる.無表情登録画像から顔認証のための表情変化の顔画像を自動生成し,顔認識システムを構成し,性能評価を行った.

<キーワード>顔認識,表情合成,主成分分析 |

AAMモデルによる表情合成 |

OS2-H1(IS1-D8)

| 顔の器官識別に基づくマーカレスモーションキャプチャの提案 |

|

○赤木康宏(鹿児島大),古川亮(広島市立大),佐川立昌(産総研), 小川原光一(和歌山大),清田祥太,沖佳憲,森永寛紀,川崎洋(鹿児島大) |

|

本稿では,顔の動きを計測した点群データに対して,フレーム間の連続性を定義するための,マーカレスモーションキャプチャ手法を提案する.計測装置により得られた点群データには時間軸上の連続性が与えられておらず,これを利用する際には様々な不利益が生じる.本稿では,顔を4種の部位に分類し,それぞれの部位の変形をNon-rigid Registration手法に基づき追跡する手法を提案する.顔形状の変形追跡を部位毎に行うことで,全体を同時追跡する手法に比べ,形状追跡の平均誤差を8.7mmから6.1mmに低減させることができた. <キーワード>マーカレスモーションキャプチャ,顔,器官識別 |

.jpg) 顔に特徴的な箇所の追跡結果 |

OS2-H2(IS1-D9)

| 追跡動線クラスタリングによるショッパー行動解析 |

|

○越中谷俊樹,奈良博之,金子俊一(北大), 李媛,三好雅則(日立製作所),藤吉弘亘(中部大),渡辺琴美(コープさっぽろ) |

|

これまでショッパー(顧客)の行動解析は,ショッパーが購入した商品をもとに行って

いた.しかしこの方法では,ショッパーがどのような経緯で購入に至ったか,迷ったが購入しなかっ

た商品などは知ることが出来なかった.解決策として人による追跡やアンケートを用いる方法があるが,コストがかかり長期間の調査は難しい.そこで本研究では,監視カメラの映像から人物検出を行い,ショッパーの動線を取得する.さらに,取得した動線をクラスタリングすることで,ショッパー

の行動を人が容易に解析できるシステムを構築する.

<キーワード>類似度,Zone,Zoneベース動線類似度算出法,Zoneベース動線クラスタリング法 |

.jpg) |

OS2-H3(IS1-D10)

| パートナーロボット視点からの観察による人・物体関連シーンの抽出 |

|

◯西丸隼人,堀元直生, 明神聖子,松尾直志,島田伸敬(立命館大)

|

|

本研究は,2人称のパートナーロボット視点からユーザを観察する事で,ユーザが必要とする過去の人・物体関連シーンの抽出を行うシステムを構築する.2人称の視点から観察する事で,場所に囚われずユーザを観察する事が出来,そしてユーザから見えていない情報も取得する事が可能となる.過去の履歴から検索を行う際は,ユーザのジェスチャから求めるシーンを特定し提示する.

<キーワード>パートナーロボット,物体検索,ジェスチャーインターフェイス |

.jpg) |